将注意力计算交给CPU,大模型解码速度提升1.76至4.99倍

CPU+GPU,模型KV缓存压力被缓解了。来自CMU、华盛顿大学、Meta AI的研究人员提出MagicPIG,通过在CPU上使用LSH(局部敏感哈希)采样技术,有效克服了GPU内存容量限制的问题。与仅使用GPU的注意力机制相比,MagicPIG在各种情况下提高了1.76~4.99倍的解码吞吐量,并在检索 ......

CPU+GPU,模型KV缓存压力被缓解了。来自CMU、华盛顿大学、Meta AI的研究人员提出MagicPIG,通过在CPU上使用LSH(局部敏感哈希)采样技术,有效克服了GPU内存容量限制的问题。与仅使用GPU的注意力机制相比,MagicPIG在各种情况下提高了1.76~4.99倍的解码吞吐量,并在检索 ......

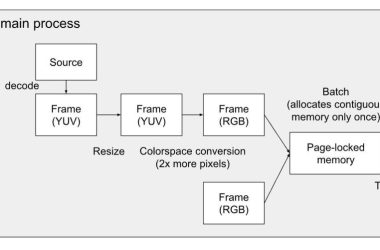

IT之家 12 月 10 日消息,训练 AI 模型的瓶颈,目前不再仅仅是架构设计,数据管理效率也至关重要。Meta AI 最新推出了开源可扩展且高性能的数据加载(SPDL)工具,通过提升数据加载效率,最终加快 AI 训练速度。SPDL 工具采用多线程技术,在常规 Python 解释器中(未启 ......