OpenAI超级对齐团队遗作:双大模型博弈,输出更清晰易懂

机器之心报道 机器之心编辑部 如果 AI 模型给的答案一点也看不懂,你敢用吗? 随着机器学习系统在更重要的领域得到应用,证明为什么我们可以信任它们的输出,并明确何时不应信任它们,变得越来越重要。 获得对复杂系统输出结果信任的一个可行方法是,要求系...

机器之心报道 机器之心编辑部 如果 AI 模型给的答案一点也看不懂,你敢用吗? 随着机器学习系统在更重要的领域得到应用,证明为什么我们可以信任它们的输出,并明确何时不应信任它们,变得越来越重要。 获得对复杂系统输出结果信任的一个可行方法是,要求系...

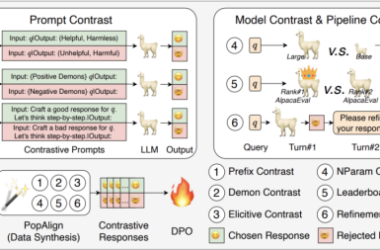

近期,北京航空航天大学、AI 初创公司零一万物、清华大学等团队合作,提出了一种 PopAlign 框架。它集成了六种对比响应的引导生成策略,全面覆盖了在响应生成过程中可能出现的各种对比先验。这些对比策略分别包括前缀对比、示例对比、引导对比、参数数量对比、排行榜对 ......