谷歌CEO警告:若OpenAI使用YouTube数据训练AI,将启动法律程序

IT之家 5 月 17 日消息,CNBC 消息,谷歌公司 CEO 桑达尔皮查伊表示:如果确定微软支持的OpenAI依赖YouTube内容来训练能够生成视频的人工智能模型,谷歌将解决这个问题(采取法律行动)。 IT之家此前报道,OpenAI首席技术官在接受采访时语焉不详,无法明确说...

IT之家 5 月 17 日消息,CNBC 消息,谷歌公司 CEO 桑达尔皮查伊表示:如果确定微软支持的OpenAI依赖YouTube内容来训练能够生成视频的人工智能模型,谷歌将解决这个问题(采取法律行动)。 IT之家此前报道,OpenAI首席技术官在接受采访时语焉不详,无法明确说...

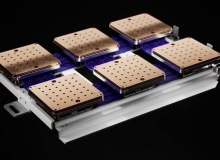

IT之家 5 月 21 日消息,据 DigiTimes,台积电宣布开始利用其 InFO_SoW 技术生产特斯拉 Dojo AI 训练模块,目标是到 2027 年通过更复杂的晶圆级系统将计算能力提高 40 倍。 ▲ 图源:特斯拉 InFO_SoW(整合型扇出晶圆级系统封装)是InFO技术应用于高性能计算...

蔡崇信 近日,美国投行摩根大通在上海举行的第二十届全球中国峰会上,阿里巴巴集团董事长蔡崇信(Joe Tsai),与摩根大通北亚区董事长兼大中华区投资银行业务副主席关金星(Kam Shing Kwang)进行对话,谈及AI所带来的价值和机遇、AGI前景等方面。 蔡崇信表...

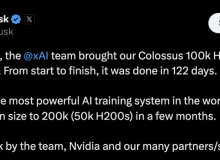

划重点 01特斯拉CEO埃隆马斯克宣布旗下人工智能初创企业x.AI打造的超级人工智能训练集群Colossus已正式上线。 02Colossus将在未来几个月内增加10万颗GPU,其中5万颗将是先进的英伟达H200,算力将再次翻倍。 03xAI计划打造一台超级计算机,名为算力的超级工厂...

划重点 01随着AI大模型训练数据的增多,版权问题日益凸显,如何划定版权边界成为关注焦点。 02专家表示,合理使用制度可以解决AI训练过程中数据来源的版权问题,避免阻碍AI技术发展。 03以音乐为例,AI音乐生成大模型可能需要学习几十亿首曲子,要求事先获得...

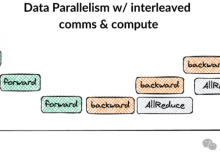

编辑:alan 【新智元导读】 近日,Nous Research宣布了一项重大突破,通过使用与架构和网络无关的分布式优化器,研究人员成功将训练LLM时GPU间的通信量降低了1000到10000倍!如果可以使用世界上所有的算力来训练AI模型,会怎么样? 近日,凭借发布了开源的He...

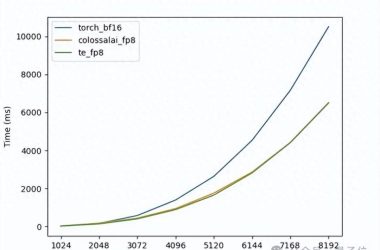

允中 发自 凹非寺量子位 | 公众号 QbitAI FP8 通过其独特的数值表示方式,能够在保持一定精度的同时,在大模型训练中提高训练速度、节省内存占用,最终降低训练成本。 AI大模型开发系统 Colossal-AI 的 混合精度训练再度升级 ,支持主流的BF16(O2) + FP8(O1)...