Midjourney与Stable Diffusion同属图像生成领域的预训练语言模型,但在多个关键维度上存在明显差异。下面,我们对其展开深入对比。

模型结构

Midjourney采用CLIP与VQGAN模型相结合的架构,且完全依托Discord平台运行。而Stable Diffusion选用的则是cliptext(基于GPT的模型)。

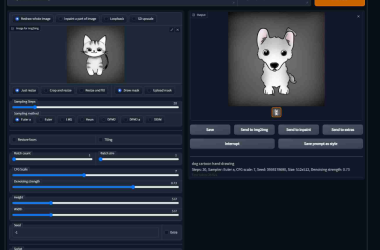

Stable Diffusion生成的图

Stable Diffusion生成的图

预训练数据

二者均借助大规模文本数据完成预训练。Midjourney的预训练数据规模约40TB,数据来源涵盖维基百科及各类互联网资源;Stable Diffusion则整合了类似维基百科的数据集,并补充了其他多元数据源。

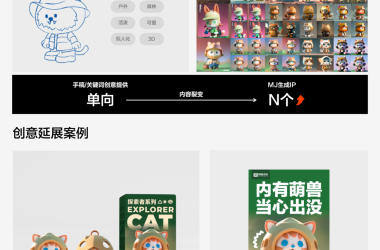

Midjourney生成的图

Midjourney生成的图

模型参数

Midjourney是目前已知参数量极为庞大的预训练图像模型之一,参数规模高达350亿。相较之下,Stable Diffusion的参数量则精简许多,为24亿。

生成能力

Midjourney与Stable Diffusion均具备产出高质量图像的能力。Midjourney擅长生成长篇文章与段落,Stable Diffusion则在短文本生成及图像多样性呈现方面更具优势。同时,两款模型均可生成高度仿真的图像,且支持在多类任务中进行微调。

可解释性

Stable Diffusion的可解释性更为突出,这得益于其融合了自回归模型与自编码器模型的架构。借助反向Diffusion技术,Stable Diffusion能够实现更可控的生成过程。

训练效率

鉴于参数数量庞大,Midjourney的训练周期相对更长,对计算资源的需求也更高。与之相比,Stable Diffusion的训练耗时则更短。

Stable Diffusion生成的图

Stable Diffusion生成的图

总体而言,Midjourney与Stable Diffusion均为实力强劲的预训练图像模型。Midjourney在语句训练上更为精准,图片存储适配性佳;生成图片后调整空间有限,若想进一步优化,通过垫图可提升精度,但借助Photoshop处理效率更高。而Stable Diffusion生成小图的速度更快,单次最多可输出9张图,垫图时还能借助画笔涂抹指定区域,操作更为灵活。此外,Stable Diffusion的结构使其更易被解释和掌控,对部分应用场景而言,具备更强的吸引力。

评论前必须登录!

注册