树莓派流畅运行大模型,实现终端自主学习与记忆|专访RockAI CEO刘凡平

量子位智库量子位 | 公众号 QbitAI2022年初,彼时OpenAI还未发布ChatGPT,RockAI就已经选择押注非Transformer路线。这一在当时看来非主流的选择,如今正逐渐显现出前瞻性。他们打造的端侧大模型已经可以在树莓派这样的微型设备上流畅运行,首批搭载Yan架构大模型的具身 ......

量子位智库量子位 | 公众号 QbitAI2022年初,彼时OpenAI还未发布ChatGPT,RockAI就已经选择押注非Transformer路线。这一在当时看来非主流的选择,如今正逐渐显现出前瞻性。他们打造的端侧大模型已经可以在树莓派这样的微型设备上流畅运行,首批搭载Yan架构大模型的具身 ......

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyun ......

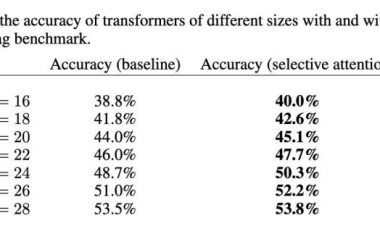

IT之家 10 月 9 日消息,科技媒体 marktechpost 昨日(10 月 8 日)发布博文,报道称谷歌公司推出了选择性注意力(Selective Attention)方法, 可以提高 Transformer 架构模型的性能。 Transformer 架构简介Transformer 是一种革命性的神经网络架构,由谷歌...

新智元报道编辑:KingHZ 好困【新智元导读】Sakana AI发布了Transformer新方法,通过奇异值微调和权重自适应策略,提高了LLM的泛化和自适应能力。新方法在文本任务上优于LoRA;即便是从未见过的任务,比如MATH、HumanEval和ARC-Challenge等,性能也都取得了提升。从章鱼 ......